Miért dominál az NVIDIA az MI-hez használt GPU-k területén?

A gépi tanulás és a nagy nyelvi modellek (LLM-ek) előretörése egy olyan számítástechnikai kihívást teremtett, amelynek megoldása sokkal több, mint egy egyszerű hardverfejlesztési kérdés. Az elmúlt évek mesterséges intelligencia robbanása olyan speciális számítási igényeket támasztott, amelyekre jelenleg szinte kizárólag az NVIDIA talált megoldást.

Az NVIDIA technológiai fölényének gyökerei

Speciális hardveres megoldások

Az NVIDIA sikerének kulcsa a Tensor Magok speciális fejlesztésében rejlik. Ezek a dedikált hardveres egységek nem csupán párhuzamos számításokat végeznek, hanem kifejezetten mesterséges intelligenciás műveletekre lettek optimalizálva. Három kritikus technológiai előnyt kínálnak:

- Gyorsított Mátrix Szorzás: A neurális hálók legfontosabb műveletének rendkívül hatékony végrehajtása

- Vegyes Pontosságú Számítások: Képesek különböző numerikus formátumok közötti konverzióra valós időben

- Mélytanulási Optimalizációk: Beépített támogatás a neurális hálók leggyakoribb műveleteihez

Szoftveres ökoszisztéma

Az NVIDIA nem csupán hardvert gyárt, hanem teljes szoftveres infrastruktúrát is:

- CUDA platformja

- cuDNN könyvtárak

- TensorRT optimalizációs eszközök

- Széles körű fejlesztői támogatás

A versenytársak helyzete

AMD kezd felzárkózni

Az AMD ROCm platformja kezd versenyképessé válni, de jelenleg még messze van az NVIDIA-tól:

- Korlátozott MI-specifikus hardveres támogatás

- Kevésbé kiforrott szoftveres ökoszisztéma

- Kisebb fejlesztői közösség

Az Intel itt (sem) találja a helyét

Az Intel Xe és Data Center GPU-k éppen fejlesztés alatt:

- Komoly K+F befektetések

- Ígéretes félvezetős tapasztalat

- Még korai szakaszban lévő MI-hardver megoldások

Miért nem minden GPU alkalmas MI feladatokra?

Hardveres Korlátok

- Tensor Magok Hiánya

- Nem minden GPU rendelkezik dedikált MI-gyorsító magokkal

- Régebbi generációs kártyák csak általános célú számításokra alkalmasak

- Memória Típusa és Mérete

- Nagy LLM-ekhez legalább 40-80 GB memória szükséges (vagy 72 milliárd paraméter feletti modellekhez ennek az értéknek a sokszorosa)

- HBM (High Bandwidth Memory) vs GDDR technológiák közötti különbségek

- Sávszélesség kritikus fontosságú

- Energiahatékonyság

- MI-s feladatok rendkívül energia-intenzívek

- Nem minden kártya képes a hatékony hőleadásra és folyamatos terhelésre

Szoftveres Kompatibilitás

- Nem minden keretrendszer támogatja azonos szinten a különböző GPU-kat

- CUDA de facto szabvánnyá válása

- Nyílt forráskódú alternatívák korlátozottsága

GPU-k szerepe LLM Inferencia során

A nagy nyelvi modellek (LLM-ek) inferenciája során a GPU-k (grafikus feldolgozóegységek) kulcsszerepet játszanak a számítási teljesítmény biztosításában. Az LLM-ek működése rengeteg mátrixműveleten alapul, amelyek hatékony végrehajtásához párhuzamos feldolgozásra van szükség. A GPU-k több ezer maggal rendelkeznek, így képesek nagyméretű mátrixszorzásokat és más tensoralapú műveleteket párhuzamosan végrehajtani, ami jelentősen csökkenti az inferencia késleltetését. Az olyan architektúrák, mint az NVIDIA Tensor Core-jai vagy az AMD MI sorozata, kifejezetten gépi tanulási feladatokhoz optimalizálták a hardveres gyorsítást, így az LLM-ek futtatása hatékonyabbá válik.

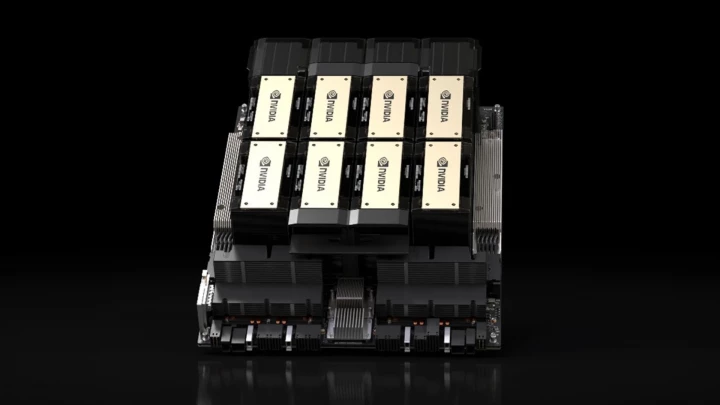

A GPU-k nemcsak a teljesítmény, hanem az energiahatékonyság szempontjából is előnyösek az LLM-inferencia során. Bár a CPU-k is képesek LLM-ek futtatására, a jelentősen nagyobb párhuzamosítási képességük miatt a GPU-k lényegesen gyorsabb eredményeket produkálnak alacsonyabb energiafogyasztás mellett. Emellett a modern AI-infrastruktúrákban elterjedt megoldások, például a több-GPU-s skálázás vagy a dedikált AI-gyorsítók (pl. NVIDIA A100, H100, AMD Instinct MI300) tovább fokozzák a feldolgozási sebességet, lehetővé téve az LLM-ek valós idejű vagy közel valós idejű használatát chatbotokban, keresőmotorokban és más AI-alapú alkalmazásokban.

Kiemelt NVIDIA GPU-k LLM Inferenciához

| GPU Modell | Tensor mag generáció | CUDA Magok | Tensor Magok | Memória | Memória Sávszélesség | Teljesítmény-felvétel |

|---|---|---|---|---|---|---|

| NVIDIA H200 Hopper |

4. | 16 896? | 528? | 141GB HBM3 | 4.8 TB/s | 600-700W |

| NVIDIA H100 Hopper |

4. | 18 432 | 576 | 80GB HBM3 | 3TB/s | 350-700W |

| NVIDIA A100 Ampere |

3. | 6 912 | 432 | 40-80GB HBM2e | 1.6-2TB/s | 250-400W |

| NVIDIA L40 Ada Lovelace |

4. | 18 176 | 568 | 48GB GDDR6 | 0.86TB/s | 300W |

| NVIDIA T4 Turing |

3. | 2 560 | 320 | 16GB GDDR6 | 0.32TB/s | 70W |

| NVIDIA Tesla P40 Pascal |

3. | 3 840 | 24 GB GDDR5 | 0.34TB/s | 250W | |

| NVIDIA RTX 5090 Blackwell 2.0 |

5. | 21 760 | 680 | 32GB GDDR7 | 1.79TB/s | 575W |

| NVIDIA RTX 4090 Ada Lovelace |

4. | 16 384 | 512 | 24GB GDDR6X | 1TB/s | 450W |

Előnyök és hátrányok

| GPU Modell | Előnyök | Hátrányok |

| NVIDIA H100 | - Csúcsteljesítmény massive LLM-ekhez - Hatalmas memóriakapacitás |

- Rendkívül magas ár - Magas energiafogyasztás |

| NVIDIA A100 | - Kiváló teljesítmény - Széles körben alkalmazott |

- Még mindig drága - Magas energiafogyasztás |

| NVIDIA L40 | - Erős teljesítmény - Jó ár-érték arány -Energiahatékonyabb |

- Alacsonyabb memória sávszélesség - Jelentős befektetés |

| NVIDIA RTX 4090 | - Kiváló ár-teljesítmény arány - Könnyen elérhető - Megfizethető |

- Kisebb memóriakapacitás - Nem adatközpont-specifikus |

| NVIDIA T4 | - Alacsony energiafogyasztás - Költséghatékony - Felhő platformokon támogatott |

- Alacsonyabb nyers teljesítmény - Korlátozott memória |

Kiválasztási szempontok

A megfelelő GPU kiválasztásakor figyelembe kell venni:

- A futtatni kívánt modell mérete

- Teljesítmény-igény

- Rendelkezésre álló költségkeret

- Energiaellátási és hűtési lehetőségek

Költségoptimalizálási stratégiák

- Infrastruktúra méretezése a tényleges igényeknek megfelelően

- Hatékony batch-feldolgozás vegyes pontosságú inferencia alkalmazása

- Modell architektúra optimalizálása

- Modell tömörítési technikák használata

GPU Alkalmasság MI feladatokra

| Kategória | Alkalmasság | Főbb Kritériumok |

|---|---|---|

| Kiváló | H200, H100, A100 | - 40+ GB memória - Dedikált Tensor Magok - HBM memória |

| Jó | L40, RTX 4090 |

- 24+ GB memória |

| Korlátozott | Régebbi gaming GPU-k | - Kevés memória - Hiányzó MI-specifikus magok |

| Nem Alkalmas | Integrált grafikus kártyák | - Minimális memória - Nincs párhuzamos számítási képesség |

Összefoglalás

Az NVIDIA jelenleg nem csupán egy GPU-gyártó, hanem egy teljes MI-ökoszisztéma megteremtője. Technológiai előnyük nem egyetlen hardveres megoldásban, hanem a komplex, integrált rendszerben rejlik.